Indhold

15. oktober 2019Hvis du søger efter en smartphone med et godt kamera, er der ingen tvivl om, at du har set Googles Pixel-serie på en liste over anbefalinger. År over år har Google fundet ud af, hvordan man laver et kamera, der leverer gode resultater hver eneste gang. Fra pixel-peeping tech-blogger til den daglige forbruger, er det svært at finde en enkelt person, der ikke elsker Pixels kameraer.

Bortset fra forsøger Google ikke at fremstille kameraer. Det prøver at lave magi.

-

- Marc Levoy

-

- Isaac Reynolds

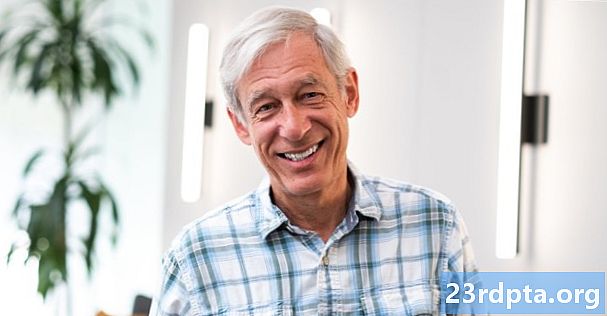

Jeg havde for nylig mulighed for at sætte mig sammen med Marc Levoy og Isaac Reynolds - kernesindene bag Pixel-seriens frustrerende godt kamerasystem. Vi havde lange samtaler om de nye funktioner i Pixel 4s kamera, fra det forbedrede Night Sight til dets WYSIWYG (Hvad du ser er hvad du får) i realtid HDR + -søger. Der var meget teknisk snak om, hvordan Google aktiverer disse funktioner, men en ting blev gjort krystalklar ved udgangen. Googles Pixel-kamera handler overhovedet ikke om at prøve at være et kamera.

”Vores kernefilosofi bygger et kamera, der udfører magi, hvilket er den kombination af enkelhed og billedkvalitet,” forklarede Reynolds, ”Så Night Sight er der stadig, standard HDR + er der stadig. Al den behandling, der foregår under hætten for at få et godt foto fra standardtilstanden er stadig der. Og vi har faktisk også gjort meget mere forenkling. ”

Standardtilstand. Forenkling. Magi. Dette er sætninger, Google bruger som en del af sin kernefilosofi for Pixels kamera. I Levoy og Reynolds sind behøver det at fange øjeblikket ikke at handle om modusopkald og indstillingsmenuer.Google forsøger ikke at opbygge et kamera i sin telefon, men prøver at opbygge noget, der giver konstant fantastiske billeder ud af porten, på traditionelle måder eller på anden måde.

Hvad du ser, er hvad du får

![]()

En af Pixel 4s nye funktioner er WYSIWYG-søgeren, hvilket betyder, at du vil se resultaterne af HDR +, før du selv tager skuddet. Dette kan virke som en mindre funktion, men det muliggør nogle ting, der bare ikke er muligt i ikke-computerstyrede kameraer.

Målet med den WYSIWYG-søger er at reducere brugerinteraktion så meget som muligt. Ved at vise det resulterende billede lige, når du åbner kameraet, ved du, om du får en jævn eksponering med det samme, og kan bare fokusere på at sømme dit billede.

”Hvis vi ser, at brugeren bankede på, ved vi, at kameraet ikke gav dem det, de ønskede fra begyndelsen.” Fortsætter Reynolds, ”Så et tryk for mig er potentielt en fiasko, som vi gerne vil forbedre .”

Traditionelle kamerasystemer er ret dårlige til at få det billede, du vil have, lige ud af kameraet. Du kan enten udsætte for højdepunkterne og hæve skyggerne senere eller udsætte for skyggerne men sprænge højdepunkterne. Takket være teknologi kan vi gøre begge dele, og det er her computerfotografering virkelig begynder at få den magi til at ske.

“At have en WYSIWYG-søger betyder nu, at vi kan overveje, hvordan du styrer eksponeringen på kameraet, hvis du gerne vil.” Siger Levoy, “Så hvis du trykker på, mens du før får en eksponeringskompensationsskyder, får du nu to skydere. Vi kalder denne funktion dobbelt eksponeringskontrol. Og det kunne være højdepunkter og skygger. Det kan være lysstyrke og dynamisk rækkevidde. Der er mange måder, du kan gøre disse to variabler på. Vi har konfigureret det til at gøre lysstyrke og skygger. Og det giver dig en slags kontrol, som ingen nogensinde har haft på et kamera før. ”

Du redigerer billedet, inden du selv tager fotografiet.

Levoy har ret. Dobbelt eksponeringskontrol er noget, der kun kan produceres gennem computational billeddannelse. Som basislinje vil billedet være jævnt med bevarede højdepunkter og synlige skygger. Men hvis du vil, har du styrken til individuelt at justere højdepunkter og skygger, før du selv tager billedet. Det er noget, du tidligere kun kunne gøre i fotoredigeringssoftware, når du har taget billedet.

Levoys team forsøger at se forbi begrænsningerne i det traditionelle kamera ved at fokusere sin indsats på de begrænsninger, som traditionelle kameraer har. Mens de fleste producenter introducerer Pro-tilstande for at give dig kontrol over blænde, lukkerhastighed og ISO, forsøger Google automatisk at skabe et bedre billede end du kunne, selvom du havde disse knap helt rigtigt.

Dræb det med læring

![]()

Så hvilke andre måder kan beregningsmæssig billeddannelse traditionelle kamerateknikker gøre? I år takler Levoys team svagt lys.

Pixel 4 introducerer læringsbaseret hvidbalance i sit kamerasystem. Denne funktion fungerer til konstant at forbedre farven på dine billeder, selv i ekstremt dårligt lys. Google er specifikt rettet mod svagt lys og gult lys og brugte natriumdamplys som et eksempel på noget, det prøver at løse, men sigter mod at få perfekt hvidbalance hver gang.

Natriumdamplamper er en type gaslampe, der har en næsten monokrom virkning på motiverne på grund af dens ekstremt smalle bølgelængde på 589nm til 589.3nm. De bruges, fordi de er en meget effektiv lyskilde, så du ofte ser det i gadelamper eller andre lys, der skal vare længe. Dette er en af de sværeste situationer at få nøjagtig hvidbalance fra, så Googles softwarefix er virkelig imponerende.

"Ville være gul i tilfælde af natriumdamplys, og vi vil forsøge at neutralisere den dårlige belysning," siger Levoy. ”Sker meget i dårligt lys. Hvis du går ind på et diskotek, og der er røde neonlamper, vil det bevare det, men vil forsøge at neutralisere noget af det ugunstige områdebelysning. ”

Læringsbaseret hvidbalance var allerede til stede i Googles Night Sight-tilstand, hvorfor dens endelige billede havde meget bedre farve end noget som auto-tilstand på Huawei P30 Pro. Systemet lærer baseret på billeder taget på enheden, det synes at være afbalanceret, og bruger de indlærede data til at producere mere farvepræcise billeder under dårligt oplyste omstændigheder. Dette er noget, traditionelle kamerasystemer bare ikke kan gøre. Når et kamera er sendt, er automatisk hvidbalance automatisk hvidbalance. På Pixel arbejder det altid med at blive bedre med tiden.

Læringsbaseret hvidbalance gør billeder med svag belysning endnu lettere, men Levoy ønsker at bruge computere til at forenkle en engang svær billedbehandling - astrofotografering.

Se til stjernerne

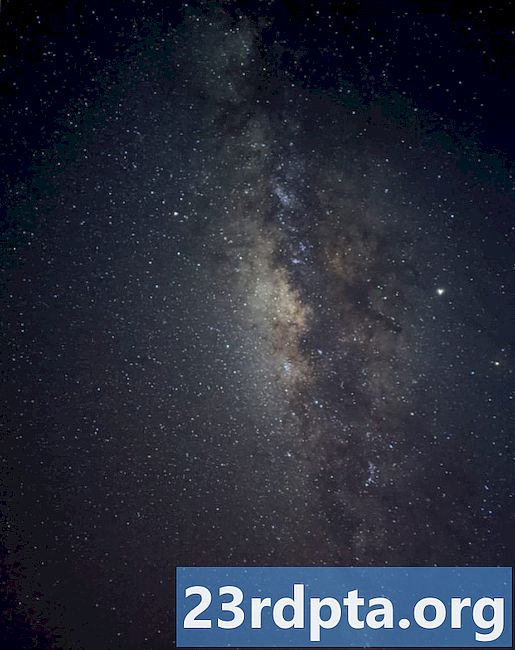

Kilde: Google

Levoy kalder denne nye kapacitet "HDR + på steroider". Hvor standard HDR + tager et burst af 10-15 korte eksponeringer og justerer og gennemsnit dem for at få skarpe billeder med lav støj, tager denne nye tilstand op til 15 sæt af 16 sekunders eksponeringer for at skabe en eksponering på 4 minutter. Systemet justerer derefter billederne (da stjerner bevæger sig over tid) og justerer de korrekte indstillinger, mens de reducerer støj med pixeld gennemsnit for at skabe nogle forbløffende billeder.

Dette var slags den hellige gral for mig.

Marc LevoyLevoy viste mig nogle eksempler på fotos, som hans team tog af den mælkeagtige måde, og min kæbe faldt bogstaveligt talt. Selvom det er muligt at gøre lange eksponeringer på traditionelle kamerasystemer, har du normalt brug for ekstra udstyr til at dreje dit kamera over tid, hvis du vil have ekstra skarpt billede. Med Night Sight kan du ganske enkelt prop din telefon mod en klippe, ramme skodden, og enheden gør resten.

Den smarteste del af denne nye Astro Night Sight-tilstand er måske, at det overhovedet ikke er en separat tilstand. Det hele sker med Night Sight-knappen. HDR + bruger allerede gyroskopet til at detektere bevægelse og justere bursts af billeder, og Night Sight vil nu registrere, hvor lang tid det kan tages et billede, afhængigt af hvor stabil enheden er, når du trykker på udløserknappen, op til fire minutter. Det vil også registrere himmel ved hjælp af en metode kaldet Semantic Segmentation, som gør det muligt for systemet at behandle visse områder af billedet forskelligt for det bedste resultat.

-

- Kilde: Google

-

- Kilde: Google

”Vi vil have, at ting skal være lette for enhver at bruge,” siger Reynolds, ”Så når som helst vi finder noget i produktet, der ikke behøver at være der, kan vi tage dette ansvar fra dig og løse det for dig.”

Denne erklæring bygger virkelig på, hvad Google forsøger at gøre med Pixels kamera. I stedet for at se, hvordan de kan få det til at fungere som et kamera, forsøger Google at løse problemer, som du ikke engang vidste, at der eksisterede, og præsentere det i en så enkel form som muligt.

Der er naturligvis fordele for begge sider. Nogle mennesker måske vil have et telefonkamera, der fungerer som et kamera, med manuelle kontroller og opkald. De ønsker måske større sensorer og Pro-tilstande. Men mens andre ODM'er næsten udelukkende fokuserer på hardware, ser Google i en helt anden retning.

Det ser ud til at lave magi.

Vil du lære mere om computerfotografering? Tjek videoen ovenfor for at se, hvordan dette felt ændrer den måde, vi laver billeder på.

‘S Pixel 4